DeepSeek V4 百万上下文,把你整部小说塞进去!

FeelFish 升级到 3.3.1 即可体验百万上下文带来的全文问答功能!

万众瞩目的 DeepSeek V4 发布了,支持了 1M 上下文,上百万字放进去都不会爆!

更重要的是,DeepSeek 全新的检索技术,使得上下文这么大也能很准确的识别和回忆关键信息,而不是像有的模型那样,号称百万上下文,其实根本难以达到很好的效果。

但是 DeepSeek V4 真正做到了百万上下文,那对于小说创作来说能做什么呢?

答案是更加强大的全文问答。

虽然之前 FeelFish 也支持通过向量检索技术实现语义搜索,但是基于向量检索的 RAG 检索的方式更多是先匹配到部分内容,再从匹配到的内容中总结答案。

而百万上下文就能做到真正意义地把全文塞给 AI,让 AI 从所有内容中去检索,一个字都不落下。

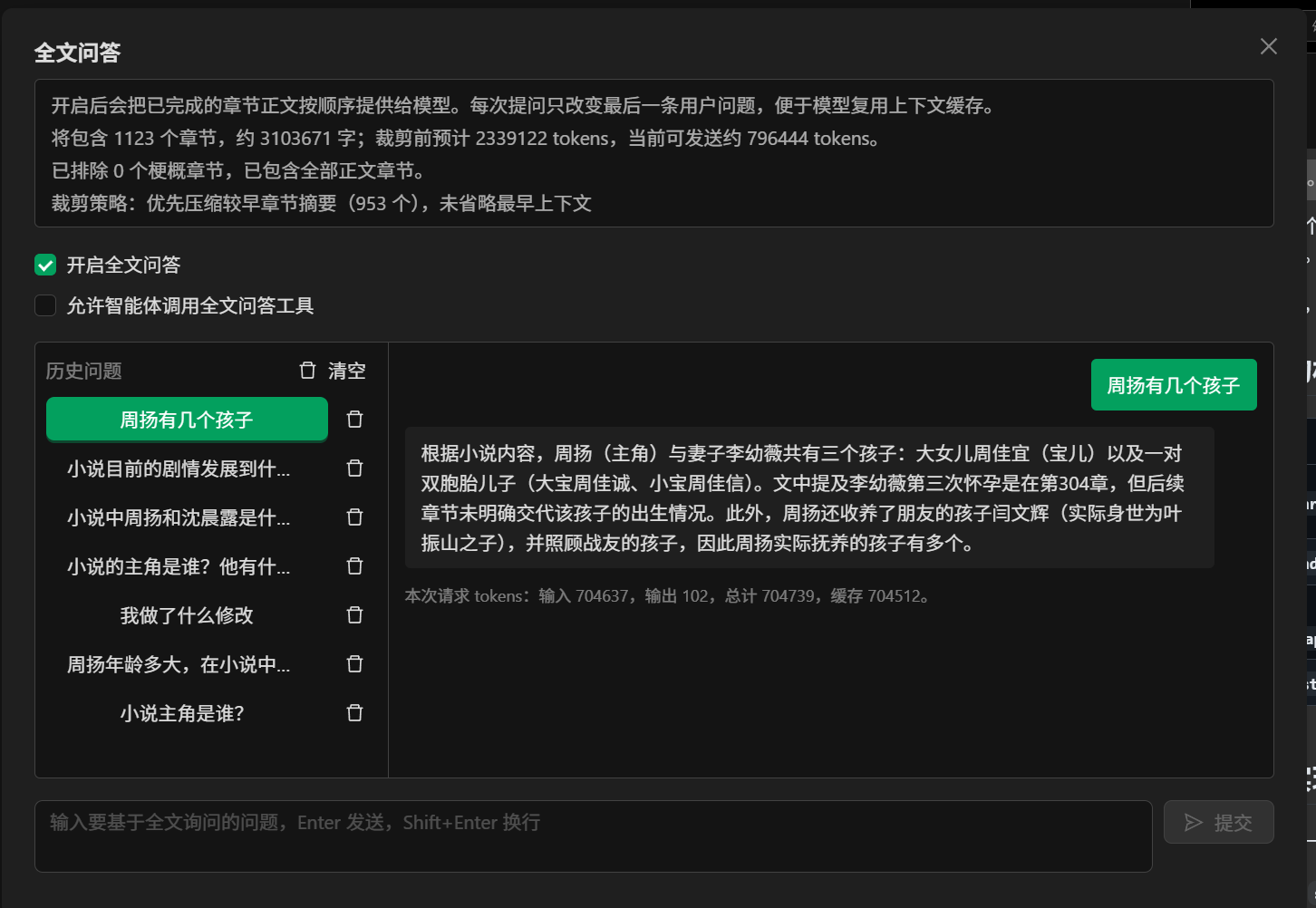

为了让智能体更好地利用这个能力,也为了帮助大家节约积分,FeelFish 全新推出了全文问答功能:

实测下来,对于百万字内的小说,我们都可以做到很好的全文问答,甚至对于超过百万字,达到三百万字的小说,我们也在合理的裁剪过后也能够很好地回答问题。

而且总要的是,我们针对性地基于 DeepSeek 强大的缓存能力,尽量地降低积分的消耗,即便是百万字的问答,在有缓存优化的情况下,一次问答也只需要消耗不到两百万积分。对于二三十万字的小说,消耗就更少了。即便是内容有新增或者修改,我们也会尽量保证缓存的可靠性,尽可能降低积分消耗。

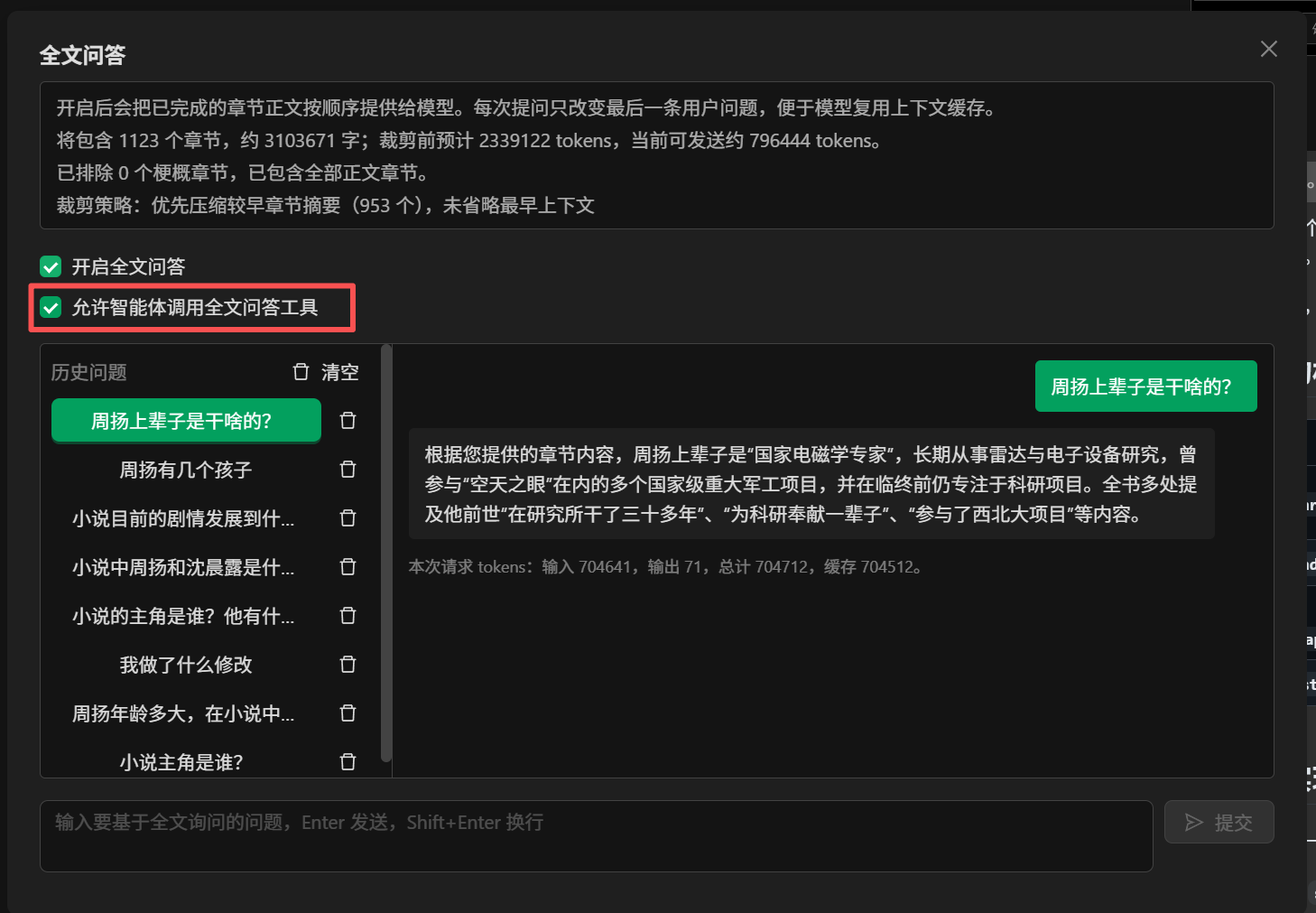

而且,这个能力有一个很大的用处,就是可以在智能体中调用,用于拆书分析或者创作的时候让智能体可以更好地获取到小说全局相关信息。只要勾选上“允许智能体调用全文问答工具”即可:

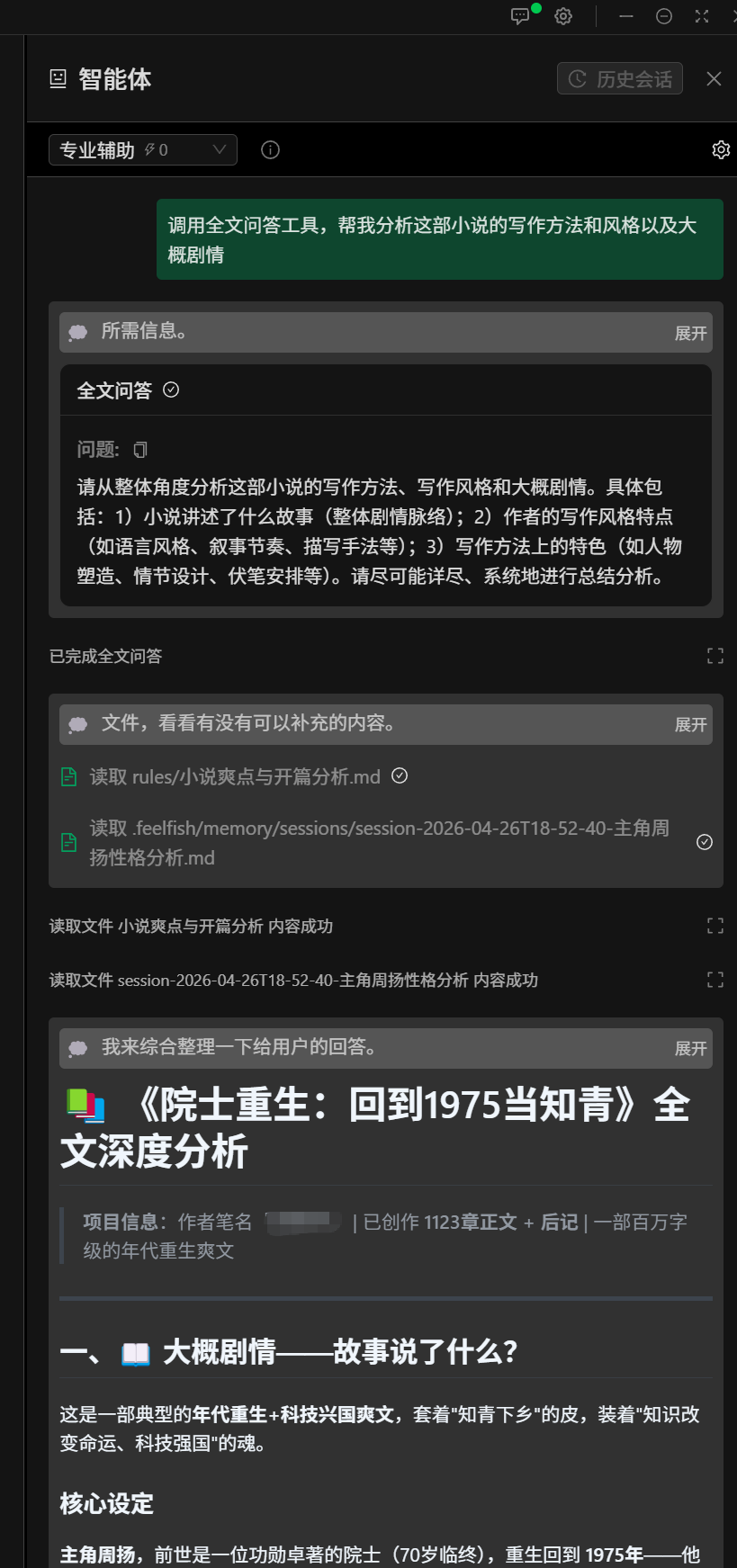

示例如下:

快来试试哦,不过要注意积分消耗哦,尤其是首次提问没有缓存,会消耗较多积分,推荐使用 DeepSeek-V4-Flash,缓存能力更强。

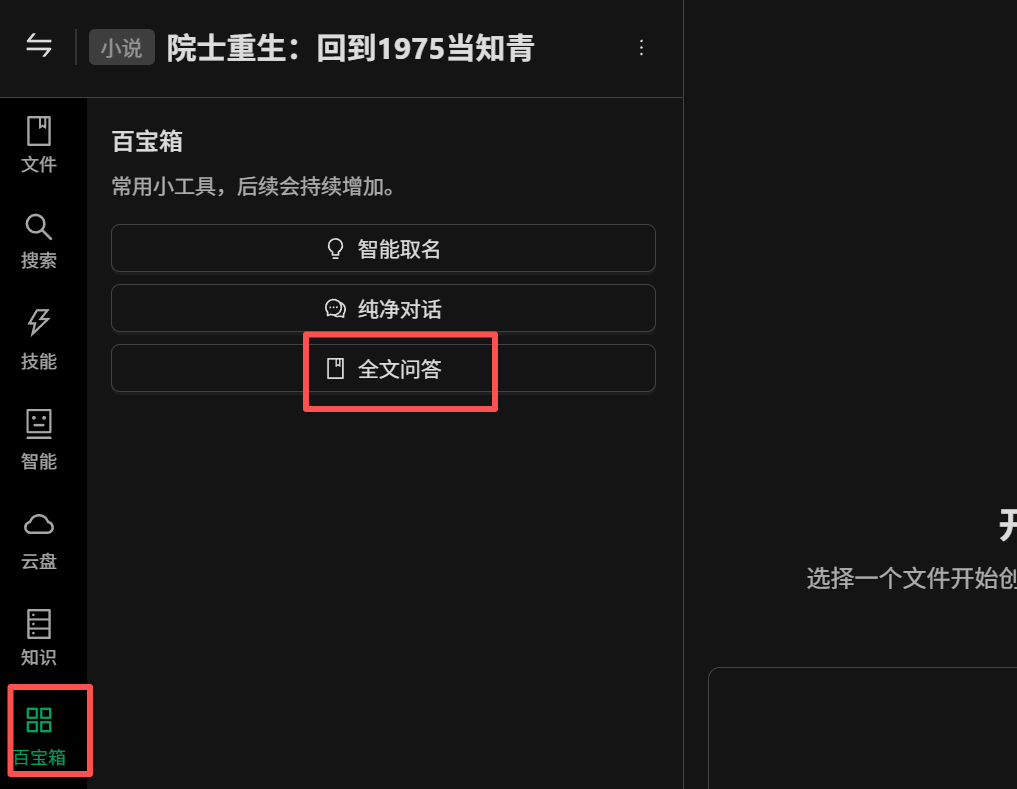

入口在百宝箱中哦: