積分消耗說明

積分消耗說明 🔋

FeelFish 請求 AI 時會消耗積分,用於支付大模型廠商的算力成本,不同的大模型消耗積分的快慢不同。發送給 AI 的內容和 AI 返回的內容消耗的積分也不同。

以目前 FeelFish 推薦的 DeepSeek V3.2 為例,下面是大概的積分消耗規則說明:

- ➡️ 你首次發送給 AI 100 個字,消耗大約 2000 個積分。

- ⬅️ AI 返回 100 個字,消耗大約 3000 個積分。

- 🔁 你再繼續發送給 AI 100 個字,這次會帶上前麵的 200 個字,這兩百個字也會消耗,但是因為有緩存所以會更便宜,隻需要十分之一的積分,大概 400 積分。加上這次新發送給 AI 的 100 個字,會消耗 2400 積分。

- 📈 如果持續在一個對話中創作,發送給 AI 的曆史消息也會越來越多,不過最終會到達上限,接近上限的時候 FeelFish 會觸發自動整理壓縮,降低積分消耗,接近上限時每次請求會消耗大概 280,000 個積分(按照年度會員的價格,大約消耗 3.5 分錢人民幣)。

按照我們的經驗估算,一億個積分如果創作得比較高效(來回修改比較少)大概可以創作 十多萬字 📚。如果改動比較多,大概可以創作 兩三萬字 ✍️。當然,理論上來說,一億積分是可以返回上百萬字的,但是實際創作的時候 AI 返回的字並不等於最終小說的內容,所以具體的消耗還要看個人創作的習慣,比如如果你習慣基於輔助創作麵闆創作,而不是用智能體,那麽積分消耗應該會更少,因為每次新開輔助創作麵闆,都是新的對話,不會包含老的曆史消息的積分消耗。

常見問題 ❓

❓ 為什麽積分消耗這麽快?

因為發送給 AI 的內容也會消耗積分,對話太長之後每次發送給 AI 的內容會太多。每次請求的積分消耗也會越來越多,不過曆史消息因為有緩存,積分消耗隻有新消息的十分之一(針對 DeepSeek V3.2 來說)。

也有可能是你用了 ChatGPT 這樣的模型,海外模型一般消耗都更大,比如 gpt-5.1 是 deepseek-3.2 的近五倍消耗 ⚠️。這些消耗都是付給大模型廠商的算力成本,所以如果你預算有限,建議選擇推薦的模型,性價比最高 💰。

❓ 有什麽方法可以減少積分的消耗?

- 🧠 任務分離:在智能體中創作的時候,每個獨立的任務新開對話,這樣每個任務曆史消息攜帶上下文比較少,消耗的積分也相對較少。比如你連續創作了三章之後,接下來要新增一個新的角色,新增角色這個任務和前麵創作三章的任務沒有關系,那麽你可以新開對話來創作新增角色這個任務。

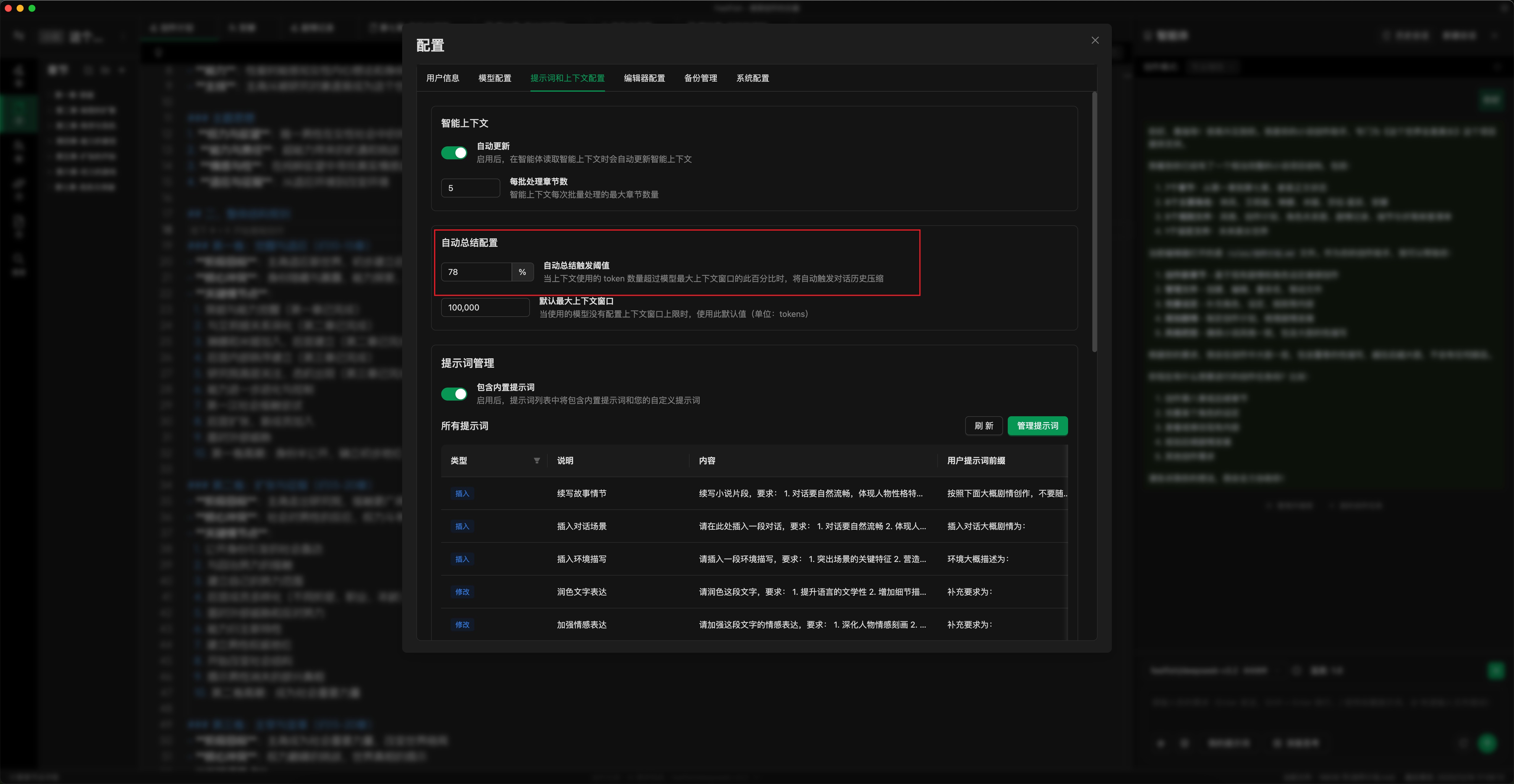

- ⚙️ 設置自動整理閾值:如下圖,結合自己使用情況設置自動整理的閾值,閾值越低,會更早出發自動整理(當然你也可以選擇手動點擊“整理並繼續”手動觸發),請求所消耗的積分上限越小。默認是 78%,你可以調低到 50~70%。(配置位置:設置彈窗->提示詞和上下文->自動總結配置)

- ✏️ 使用輔助創作麵闆:精細化的修改可以使用輔助創作麵闆,更加精準的修改指定內容,減少和 AI 來回對話的次數,降低積分消耗。

- 💾 使用帶輸入緩存的模型服務:盡量使用帶輸入緩存的模型服務(比如 DeepSeek),這樣曆史消息的積分消耗會更少(比如對於 DeepSeek V3.2 來說,曆史消息所帶來的積分消耗是新消息的十分之一)

- 🤖 選擇合適的模型:選擇合適的模型創作,日常創作推薦使用 DeepSeek 最新模型。

伴隨大模型持續發展和算力的豐富,大模型廠商的模型價格也會越來越低,FeelFish 也會對應調整積分消耗規則,爭取給大家帶來更好的體驗。

❓ 如何查看每次請求的積分消耗

你可以在 FeelFish 客戶端編輯器下面狀態欄的日誌中查看每次請求的積分消耗 📊。

❓ 所有模型都有曆史消息緩存嗎?

不是,不同模型的緩存邏輯和價格都不一樣。🔍 DeepSeek 針對曆史消息會有幾十分鍾到幾個小時時間不等的緩存,不過基本上緩存能力是確定的,曆史消息所帶來的積分消耗是新消息的十分之一。對於大部分用戶來說,推薦使用默認的模型,這是我們挑選出來的更具有性價比的模型。

GLM 模型的緩存也相對確定,但是價格更貴一點 💸。其它模型的緩存邏輯不確定,不建議在智能體中使用(多輪對話會依賴緩存減少積分消耗),但是可以在輔助創作麵闆中使用。

積分消耗詳細說明 🔍

🔊 FeelFish 的大部分成本都來自於大模型廠商的算力消耗,也就是對應 AI 的 Token 消耗。FeelFish 支持全球主流模型,同一個 AI 請求可以選擇不同的模型,因為不同的模型 Token 價格不同,所以 FeelFish 通過統一的積分來衡量算力的消耗。

所以不同的模型的 Token 有各自的積分消耗的價格,以 DeepSeek V3.2 為例,每百萬個 Token(大概對應近兩百萬字,Token 和字數並不是完全對應的)輸入需要消耗 28,000,000 個積分,輸出需要消耗 42,000,000 個積分。差不多就是發送兩個字需要消耗 28 個積分,返回兩個字需要消耗 42 個積分。 ⚖️

🧑💻 當然實際創作的時候,創作出一個消耗的 Token 是不確定的,所以真正創作的時候積分的消耗取決於創作者的創作方式。

所有大模型實際 Token 對應的積分消耗請登錄後訪問 積分消耗 查看。 🔗

因為不同的模型緩存策略和計費價格不同,本文檔僅供參考,最終以大模型廠商的實際 Token 消耗計費為準。